Wydaje Ci się, że cyberatak to skomplikowany kod zielonych literek na czarnym ekranie? Microsoft właśnie opublikował raport, który burzy ten filmowy obraz. Okazuje się, że sztuczna inteligencja stała się ulubionym narzędziem hakerów, a ich nowa metoda walki przypomina raczej proces rekrutacyjny niż klasyczne włamanie.

W mojej pracy redakcyjnej widziałem już wiele wycieków danych, ale to, co dzieje się teraz, to zupełnie nowa liga. AI nie zastępuje hakerów – ono daje im supermoce, pozwalając na masową skalę tworzyć pułapki, które są niemal nie do wykrycia przez ludzkie oko.

Nowy pracownik może być botem z Korei Północnej

Zauważyłem, że najbardziej zaskakującym elementem raportu jest taktyka grup takich jak „Jasper Sleet”. Zamiast wyważać cyfrowe drzwi, hakerzy... zatrudniają się w zachodnich firmach jako zdalni specjaliści IT. AI pomaga im w tym na każdym kroku:

- Generuje perfekcyjne życiorysy (CV), idealnie dopasowane do wymagań w ogłoszeniach.

- Tworzy setki wiarygodnych tożsamości z lokalnymi nazwiskami i adresami e-mail.

- Pisze profesjonalne listy motywacyjne, których styl nie budzi żadnych podejrzeń rekruterów.

Kiedy taki „pracownik” dostaje dostęp do wewnętrznych systemów, drzwi do firmy stają przed przestępcami otworem. To tak, jakbyśmy sami wręczyli złodziejowi klucze do sejfu, myśląc, że to nowy kolega z działu programowania.

AI jako „mnożnik siły” w rękach oszustów

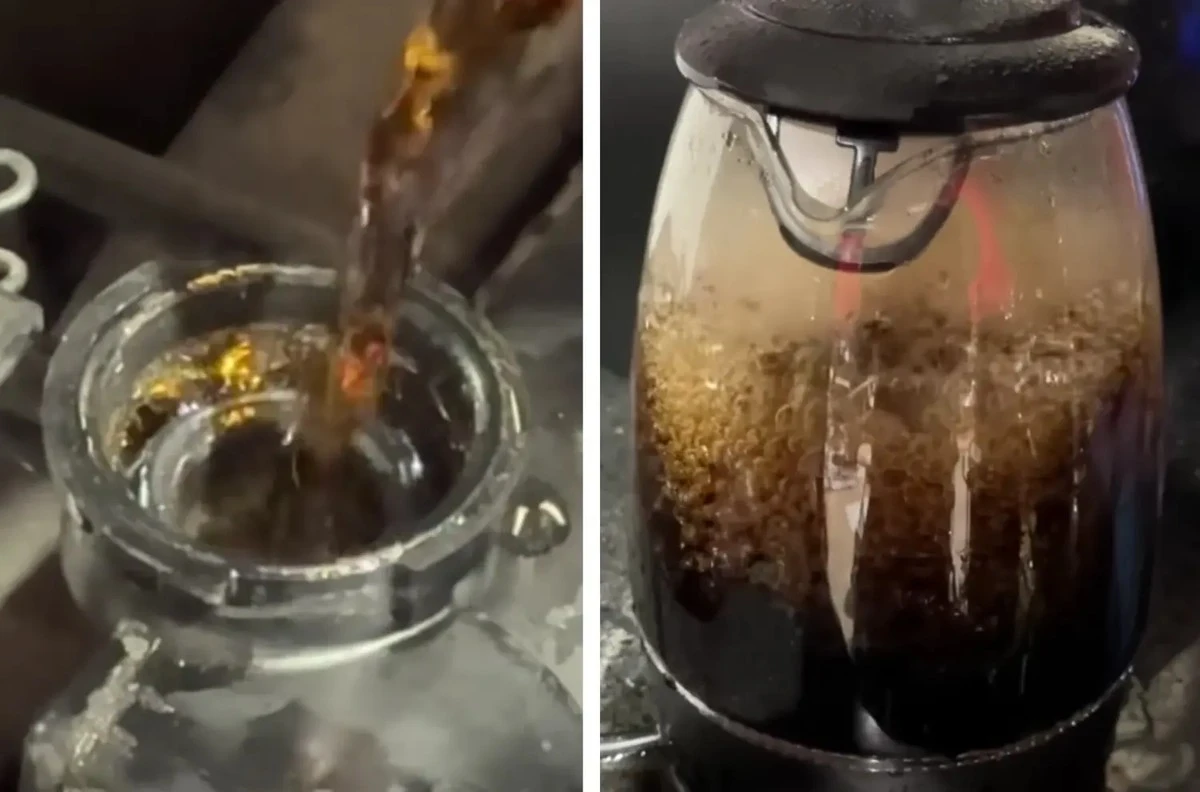

Wielu z nas kojarzy AI z pisaniem wierszy czy generowaniem obrazków. Jednak w świecie cyberprzestępczości sztuczna inteligencja działa jak filtr kawowy dla danych – odsiewa to, co nieistotne, i pozwala błyskawicznie znaleźć najsłabsze ogniwa w naszych zabezpieczeniach.

Choć algorytmy same nie podejmują decyzji o ataku, niesamowicie przyspieszają żmudne zadania. Zamiast poświęcać dni na pisanie złośliwego kodu, haker prosi AI o „poprawienie błędów” lub „przepisanie fragmentu na inny język”. Microsoft ostrzega, że narzędzia te są używane do:

- Tworzenia wyjątkowo przekonujących maili typu phishing (koniec z błędami ortograficznymi, które nas ostrzegały!).

- Analizowania ogromnych ilości skradzionych danych w poszukiwaniu haseł.

- Automatyzacji ataków, które mogą zmieniać swoje zachowanie w czasie rzeczywistym.

Nuance z blokadami bezpieczeństwa

Być może myślisz: „Przecież ChatGPT ma zabezpieczenia”. To prawda, ale przestępcy stosują tzw. jailbreak. To sprytne formułowanie pytań, które zmusza AI do ominięcia własnych zasad i np. napisania fragmentu kodu służącego do infekowania komputerów.

Jak nie dać się złapać w nowej rzeczywistości?

W Polsce, gdzie coraz więcej z nas pracuje zdalnie, zagrożenie jest realne. Ataki oparte na AI wyglądają jak zwykła komunikacja firmowa. Co możemy zrobić? W mojej praktyce sprawdzają się trzy proste zasady:

- Weryfikuj nietypowe prośby: Jeśli szef prosi Cię o pilny przelew lub dostęp do danych przez komunikator, zadzwoń do niego.

- Zwracaj uwagę na anomalie logowania: Jeśli system zgłasza logowanie z innego miasta, nie ignoruj tego.

- Stosuj zasadę ograniczonego zaufania: Nawet jeśli e-mail wygląda profesjonalnie, nie klikaj w linki bez sprawdzenia nadawcy.

Sztuczna inteligencja nie jest już tylko ciekawostką – to cyfrowy wyścig zbrojeń. Czy Wasze firmy wprowadziły już dodatkowe procedury weryfikacji tożsamości pracowników zdalnych?

Dajcie znać w komentarzach, czy spotkaliście się już z podejrzanie idealnie napisanymi mailami, które mogły wyjść spod „pióra” bota.