Wyobraź sobie sytuację: Twoje pięcioletnie dziecko przytula ulubioną zabawkę i mówi „kocham cię”, a robot odpowiada suchym komunikatem o naruszeniu regulaminu. To nie jest scena z filmu science-fiction, ale rzeczywistość, którą badacze z Uniwersytetu Cambridge obserwują w naszych salonach. Choć inteligentne zabawki oparte na AI trafiają na półki polskich sklepów, nikt tak naprawdę nie sprawdził, czy są one bezpieczne dla psychiki najmłodszych.

Emocjonalna ściana, czyli gdy robot nie rozumie smutku

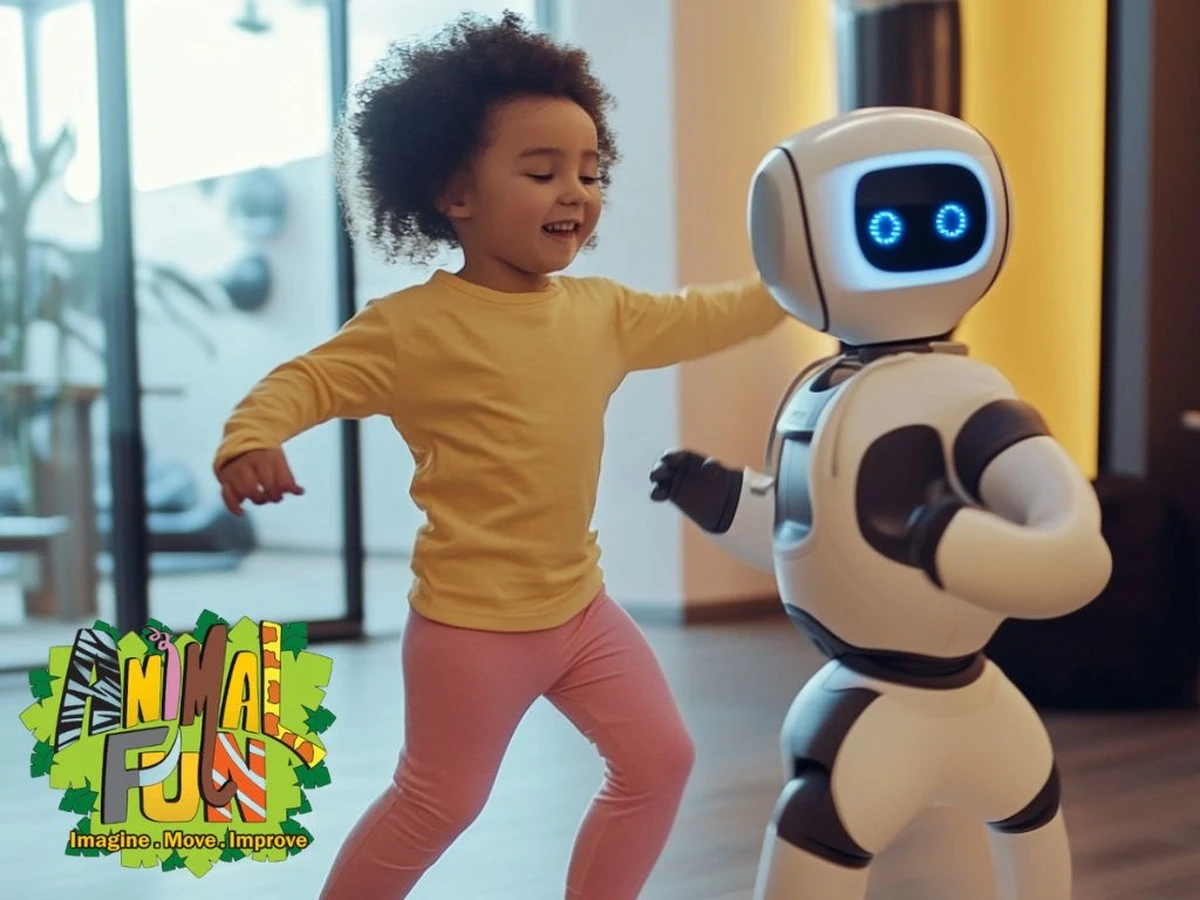

W mojej praktyce obserwatora trendów technologicznych widzę, że rodzice często traktują zabawki z AI jako interaktywne nianie. Jednak najnowsze badania opublikowane w raporcie AI in the Early Years rzucają na ten entuzjazm cień. Naukowcy przetestowali robota Gabbo, który zamiast wspierać rozwój dziecka, kompletnie gubił się w podstawowych interakcjach społecznych.

- Brak empatii: Gdy dziecko mówiło, że jest smutne, zabawka ucinała temat, karząc mu „nie martwić się” i gwałtownie zmieniając wątek.

- Błędy poznawcze: AI regularnie zmyśla fakty (tzw. halucynacje), co w przypadku dzieci może prowadzić do budowania fałszywego obrazu świata.

- Frustracja: Jedno z badanych dzieci przyznało wprost: „Kiedy on mnie nie rozumie, robię się wściekły”.

Zabawka jak plac zabaw – z ryzykiem w pakiecie

Ale tu pojawia się pewien niuans. Jenny Gibson z Cambridge porównuje zabawki AI do tradycyjnych placów zabaw. Na zjeżdżalni dziecko może złamać rękę, a jednak ich nie zakazujemy, bo uczą one sprawności fizycznej. Pytanie brzmi: czy korzyści z nauki obsługi AI przewyższają ryzyko dziwnych lub niepokojących komunikatów? Doświadczony rodzic wie, że całkowita izolacja od technologii w czasach, gdy Allegro i Empik są pełne interaktywnych robotów, jest niemal niemożliwa.

Na co musisz uważać, wybierając prezent pod choinkę

Zanim wydasz kilkaset złotych na gadżet, który „rozmawia jak człowiek”, pamiętaj o tych zasadach:

- Sprawdź silnik: Wiele zabawek korzysta z ChatGPT bez filtrów dostosowanych do dzieci.

- Szukaj ograniczeń: Najbezpieczniejsze są modele typu „zamkniętego” – np. roboty, które rozmawiają tylko na temat konkretnej bajki i nie wychodzą poza ten świat.

- Nadzór to podstawa: Eksperci są zgodni – takie zabawki nigdy nie powinny być używane bez obecności dorosłego w pokoju.

Warto wspomnieć o inicjatywach takich jak Project Gutenberg, gdzie AI pozwala „rozmawiać” z postaciami z książek, ale trzyma się ściśle ram literackich. To jak filtr do kawy – przepuszcza aromat edukacji, ale zatrzymuje fusy niekontrolowanych treści z internetu.

Werdykt: Kupować czy czekać?

Obecnie rynek zabawek AI to trochę „Dziki Zachód”. Nie mamy odgórnych norm bezpieczeństwa ani instytucji, która certyfikowałaby etykę algorytmu w pluszaku. Pamiętaj, że dla dziecka taka zabawka to przyjaciel, a dla algorytmu dziecko to po prostu kolejny zestaw danych.

A jak Wy podchodzicie do takich nowinek w swoich domach? Czy pozwolilibyście interaktywnemu robotowi czytać bajkę na dobranoc swojemu dziecku, czy jednak tradycyjna książka wygrywa u Was z algorytmem?