Wyobraź sobie, że ktoś może odtworzyć film, który oglądałeś wczoraj, analizując jedynie impulsy elektryczne w Twojej głowie. Choć brzmi to jak scenariusz z „Black Mirror”, badacze z University College London właśnie tego dokonali. Udało im się zrekonstruować nagrania wideo na podstawie samej aktywności neuronalnej.

Dlaczego to odkrycie jest tak ważne właśnie teraz? Ponieważ granica między prywatnością naszych myśli a technologią cyfrową zaczyna niebezpiecznie znikać. Zrozumienie, jak mózg „koduje” rzeczywistość, to klucz do medycyny przyszłości, ale i ogromne wyzwanie etyczne, przed którym staniemy szybciej, niż nam się wydaje.

Jak algorytm „wyjmuje” obrazy z głowy?

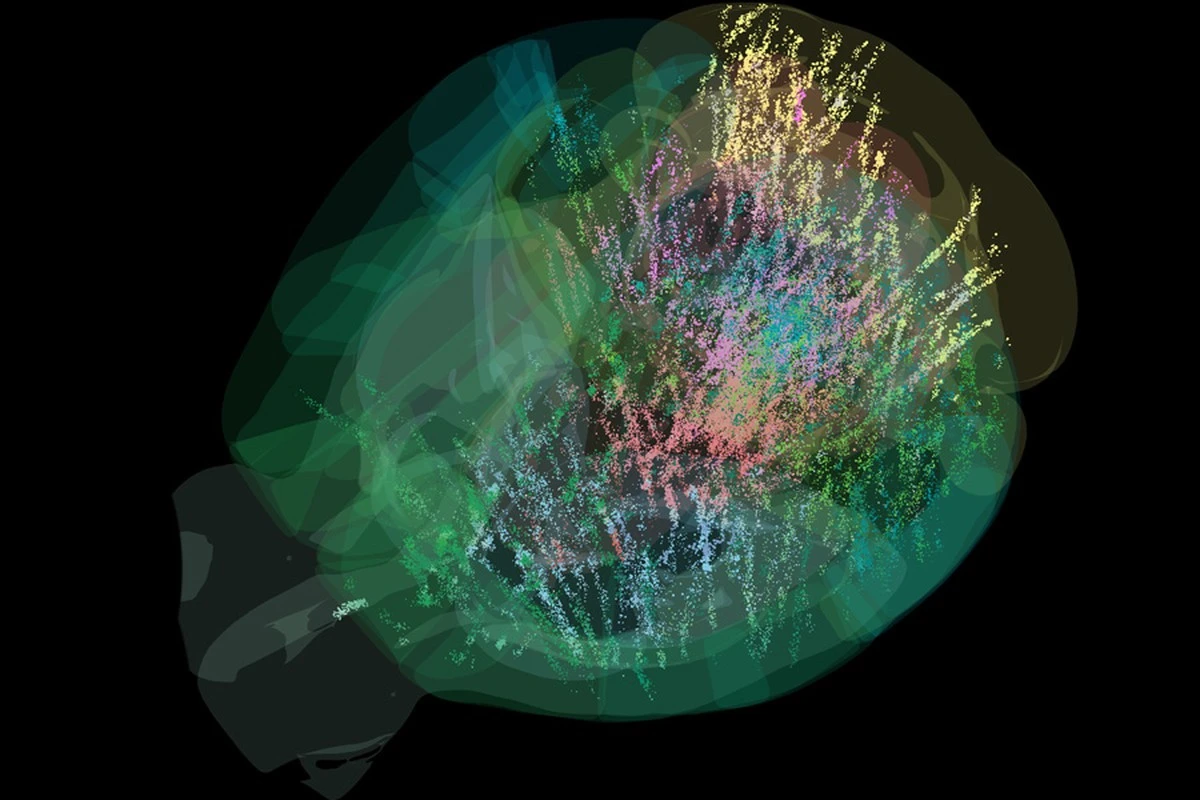

Naukowcy nie użyli magicznej kuli, lecz zaawansowanego modelu matematycznego. Obserwowali myszy oglądające 10-sekundowe filmy i mierzyli, które neurony w korze wzrokowej „strzelają” w odpowiedzi na konkretne piksele. Ale jest pewien haczyk, o którym wielu zapomina.

- Ruch ma znaczenie: System brał pod uwagę nie tylko wzrok, ale i to, jak szybko mysz biegła oraz jak szerokie miała źrenice.

- Metoda szarego ekranu: Aby obraz był wyraźniejszy, badacze odejmowali „szum” tła, porównując aktywność mózgu podczas patrzenia na pusty ekran z tą właściwą.

- Piksel po pikselu: Algorytm aktualizował obraz tak długo, aż przypominał on to, co faktycznie działo się przed oczami zwierzęcia.

W mojej praktyce rzadko widuję tak precyzyjne wyniki – naukowcy osiągnęli niemal dwukrotnie wyższą dokładność niż w poprzednich latach. To dowodzi, że nasze mózgi generują dane znacznie bardziej szczegółowe, niż potrafiliśmy do tej pory odczytać.

To nie jest kopia 1:1, to interpretacja

Najciekawsze jest jednak to, że uzyskane filmy nie są idealnymi kopiami HD. I wcale nie o to chodziło. Joel Bauer, lekarz neurobiolog prowadzący badania, zauważył coś fascynującego: nasz mózg nie jest kamerą. On zniekształca rzeczywistość.

To, co widzimy w głowie, jest filtrowane przez nasze doświadczenia. To trochę jak filtr w Instagramie, który zmienia kolory i kontury, abyśmy lepiej rozumieli to, co jest dla nas istotne. To nie błąd systemu, to funkcja, która pozwala nam przetrwać.

Praktyczny wymiar: Co to oznacza dla Ciebie?

Choć technologia testowana jest na myszach, wnioski płynące z UCL są bliskie każdemu z nas. W Polsce coraz częściej mówi się o interfejsach mózg-komputer. Oto co warto wiedzieć:

- Lepsza protetyka: W przyszłości takie algorytmy mogą pomóc osobom niewidomym „widzieć” poprzez bezpośrednią stymulację mózgu obrazem z kamery.

- Trening skupienia: Wiedząc, jak mózg reaguje na bodźce wizualne, możemy tworzyć skuteczniejsze metody pracy głębokiej (Deep Work).

Przejście od czytania prostych emocji do rekonstrukcji niemal płynnych filmów to milowy krok. Ale czy jesteśmy gotowi na świat, w którym nasze wizualne wspomnienia można wyeksportować do pliku mp4?

Czy czulibyście się bezpiecznie, wiedząc, że technologia potrafi zajrzeć pod Waszą czaszkę i zobaczyć to, co Wy? Zapraszam do dyskusji w komentarzach – Wasza opinia na temat prywatności myśli jest dla nas bardzo ważna.