Sztuczna inteligencja staje się tak łakoma na energię, że wkrótce może zużywać więcej prądu niż cała Japonia. Deweloperzy AI szukają dziś ratunku wszędzie – niektórzy myślą nawet o wysłaniu serwerów w kosmos, by czerpały energię ze słońca. Ale rozwiązanie, które właśnie zyskuje miliony dolarów finansowania, znajduje się znacznie bliżej: na środku oceanu.

Firma Panthalassa buduje autonomiczne, pływające centra danych. Wyglądają jak gigantyczne pole golfowe wystające z wody, a ich celem jest uniezależnienie się od przeciążonych sieci energetycznych na lądzie. Czy to faktycznie przyszłość internetu, czy tylko bardzo drogi eksperyment?

Obiekt przypominający piłkę golfową na środku morza

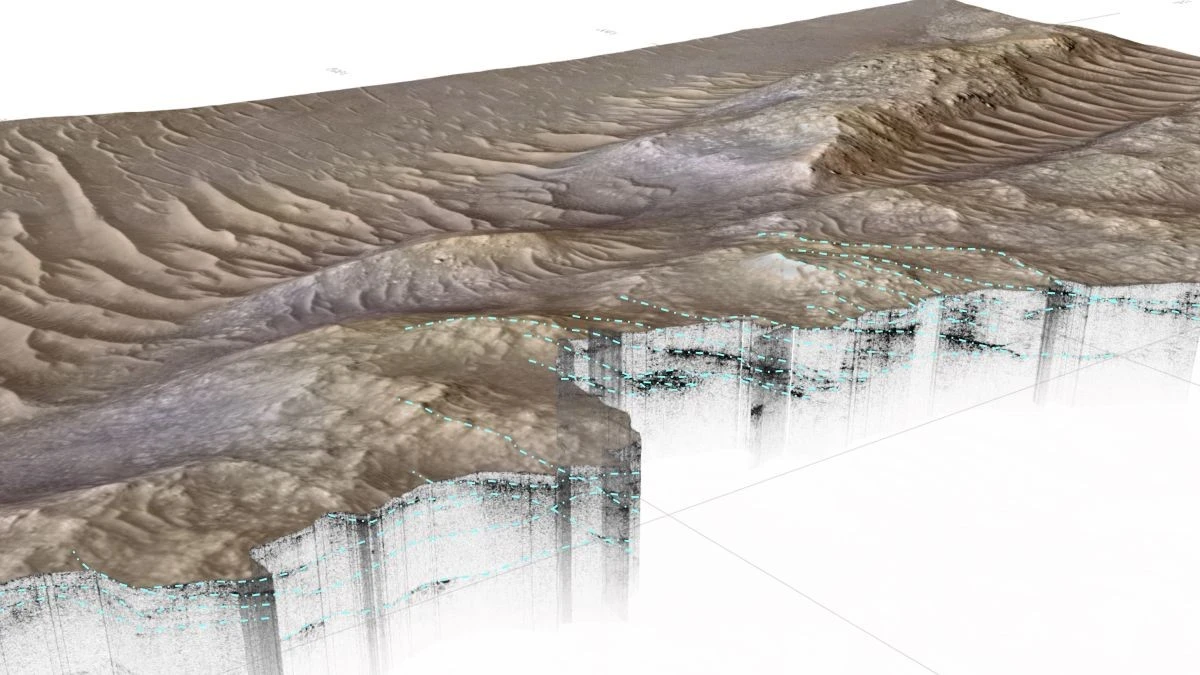

Platformy te mają 85 metrów wysokości – niemal tyle, co Big Ben. Ich konstrukcja jest genialna w swojej prostocie: kiedy fale unoszą i opuszczają stalowy kadłub, woda morska wtłaczana jest do specjalnej rury. Ruch cieczy napędza turbiny, które dostarczają energię bezpośrednio do układów AI znajdujących się wewnątrz.

To, co mnie w tym fascynuje, to kwestia chłodzenia. Zwykłe serwerownie w Polsce czy w USA muszą zużywać ogromne ilości wody, aby nie spłonąć od nadmiaru ciepła. W przypadku urządzeń na oceanie, ściany stalowych modułów zanurzonych w zimnej wodzie działają jak naturalny radiator. To niemal darmowe chłodzenie, o jakim marzy każdy administrator sieci.

Prawdziwe wyzwania, o których mało kto mówi

Zanim jednak zaczniemy przesyłać dane przez pełny ocean, musimy zmierzyć się z brutalną rzeczywistością. Eksperci z branży wskazują na trzy główne problemy, które mogą pogrążyć ten pomysł:

- Słona woda to wróg maszyn. Sól morska i nieustanne uderzenia fal to najgorsze środowisko dla delikatnej elektroniki.

- Zero serwisu. Jeśli w serwerowni pod Radomiem coś się zepsuje, technik jest na miejscu w godzinę. Na środku oceanu każda usterka to logistyczny koszmar.

- Opóźnienia (latency). Przesyłanie danych przez satelity Starlink jest wolniejsze niż przez światłowód. Dla ChatGPT czy wyszukiwarek czas reakcji jest kluczowy – tutaj może być z tym problem.

Czy to w ogóle ma sens ekonomiczny?

Obecnie większość gigantów buduje ogromne huby obliczeniowe, żeby rozłożyć koszty stałe na jak największą moc. Budowa "pływającego komputera" jest znacznie bardziej ryzykowna niż postawienie zwykłej hali pod miastem. Dlatego na razie takie rozwiązania mają sens głównie dla bardzo specyficznych zadań, takich jak trenowanie zaawansowanych modeli AI, gdzie proces trwa dniami i nie wymaga odpowiedzi w milisekundach.

Warto pamiętać: Technologia ta jest wciąż w powijakach. Choć Microsoft już wcześniej testował podwodne centra danych (projekt Natick), to wciąż raczej obszar dla odważnych pionierów niż standard dla całego rynku.

A jak Wy sądzicie – czy przeprowadzka serwerów na oceany to jedyna szansa na zaspokojenie głodu energii przez AI, czy może po prostu zbudujemy jeszcze więcej elektrowni jądrowych na lądzie?